「Stable Diffusion UI」を導入してみた。しかし…(その3)

こんばんは。暇と隙さえあればAIに画像の生成ばかりさせている、悪趣味を自覚しているテルミナ™です。

先週末に導入した「Stable Diffusion UI」、フルに活用しております。

- 関連記事

しかし、ほとんど一日中画像生成処理をさせていても、なかなか自分の希望通りの画像が出力されないものです。

「Stable Diffusion UI」、というより「Stable Diffusion」は極めて有用なサービスであり、もうこれだけで一生遊べるのではと思えるくらいの中毒性もあります。

とはいえ、もちろん使っているうちに不満点もいろいろ出てきています。まあ、そんな不満点があってもなお有用であることに変わりはないから使い続けているんですけどね。

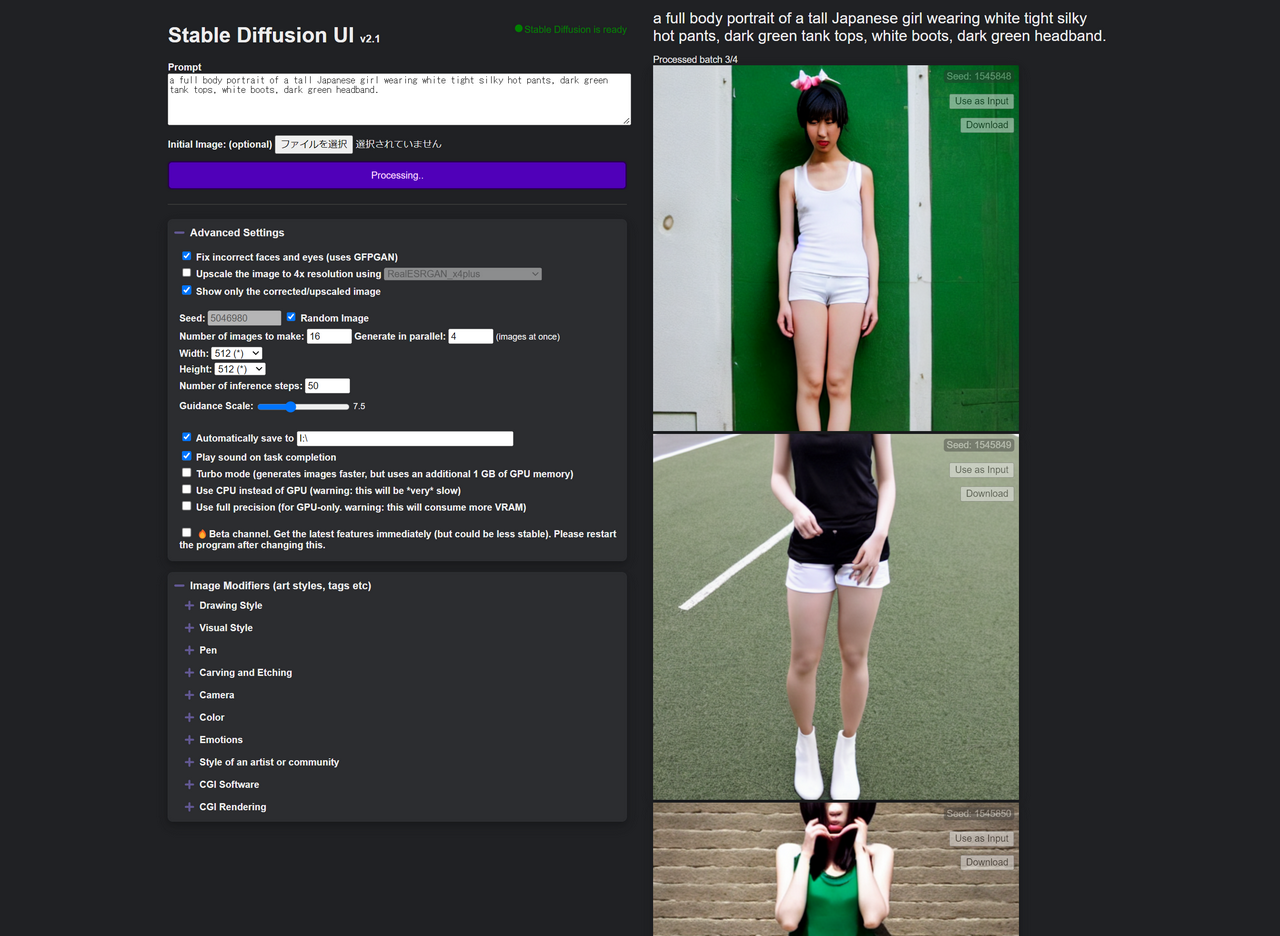

衣服の色指定はあまり守ってくれない

自分はとある特徴を持った人物画像を出力することが極めて多いです。もちろんこれは自分の趣味全開なのですが。

- 長身の日本人少女

- 衣装はタイトで絹のような白ホットパンツ、暗い緑色のタンクトップ、白ブーツ、暗い緑のヘッドバンド

たまにほかの条件も付加したりしますが、基本的には下記のテキストで出力を指示しています。

- a full body portrait of a tall Japanese girl wearing white tight silky hot pants, dark green tank tops, white boots, dark green headband.

ところが、指示通りに書き出してくれることはまれで、ホットパンツやブーツを緑色にされてしまい、タンクトップを白や黒にされてしまうことがよくあります。

あと、時々、ホットパンツを指定しているのにロングパンツが描き出されてしまって萎えてしまうこともあります(ぉぃ)。

単独の人物の画像だと、全身画像もなかなか書きだしてくれない

さらに、特に単独の人物を書き出す指定にしている場合、頭のてっぺんからつま先(ブーツの先端)まですべて写った画像が欲しいのですが、それもまれにしか書き出されず、大抵は首より上か膝より下のいずれかもしくは両方が画像の範囲外に出てしまいます。

全身画像については、これまで下記のようなキーワードを試してみたのですが、いずれも効果ないようです。

- whole body

- full body

- full size body

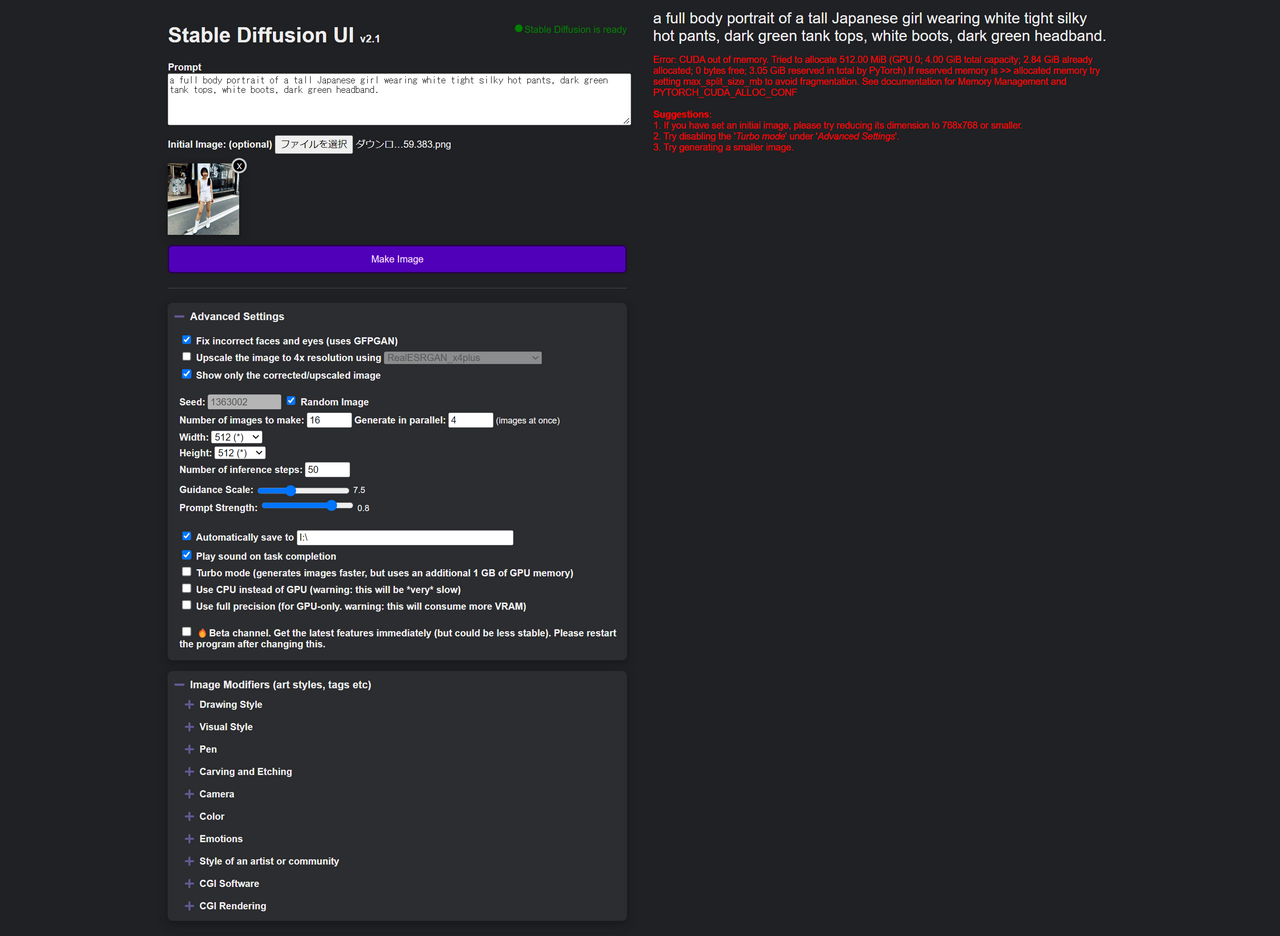

非力な環境だと元画像指定が無効になる

以前から申し上げておりますように、自分が「Stable Diffusion UI」を導入したPCは、購入当初ゲームや重い画像処理などをさせる予定が一切なかったため、購入時点で構成をカスタマイズしてグラフィックカードを最低クラスのものに下げております。

しかしそれが仇となり、「Stable Diffusion UI」を本来の性能で利用できていません。

これは、「Stable Diffusion UI」の売りの機能の一つである、元画像を指定した画像生成が出来ないということをも意味します。

「Initial Image: (optional)」に画像を指定することで、それを元に新たに画像を書き出してくれるそうなのですが、自分の環境でそれを試すと、エラーになってしまいます…。

やはりそう遠くない将来、画像生成専用端末を買った方がいいかもしれませんね…。

生成された人物画像に様々なアクションをさせにくい

一度画像を生成したあと、Seed値を変更せずに描画支持の条件を少しだけ変えることで、画像の雰囲気を大きく変えずに別の視点、別のアクションの画像を描き出させることが出来る場合があります。

「場合がある」と申し上げたのは、100%それが出来るからではないのですが、その点が個人的には結構不満だったりします。

例えば、前を向いているときにむっちりした白ホットパンツを穿いていていい感じと思っていた人物の画像に対し、同じSeed値で後ろ向きを指示したときにはロングパンツになったり、そうでなくてもホットパンツの色が変わったり、なんてことが結構あります。

AIがどういう基準で描画しているのかさっぱりわかりませんけど、指示したことは守って欲しいです…。

人物画像としておかしい点はほかにもある

人物を描き出させていると、時々首をかしげてしまう画像が生成されることがあります。

これまでにはこんなことがありました。

- 手や足が不自然なところから生えていたり、途中でなくなったりしている。

- 特に複数人が登場する画像を出力するときに発生しやすい。

- 白ブーツを描き出させる設定の時に、足の途中からだんだんグラデーションして肌の色が白くなっていってブーツと一体化するというあり得ない画像が生成されることが結構ある。

- 指の描画は結構いい加減。

- 顔の造形について、いいときと悪いときの差が結構激しい。

- その他諸々

とはいえ、それでもなおこのツールは有用である。

いろいろと不満点も出てきていますが、それでもなお、「Stable Diffusion UI」、というより「Stable Diffusion」が極めて有用なサービスであることに代わりはありません。

今後さらに改良が重ねられて、現在受け付けられていないキーワードを受け付けられたり、不自然な描画が改善されたりすることを、願いたいものです。

- 関連記事

- Next

#2022年 #2022年9月 #2022年9月14日 #StableDiffusion #StableDiffusionUI #AI #PC #Windows